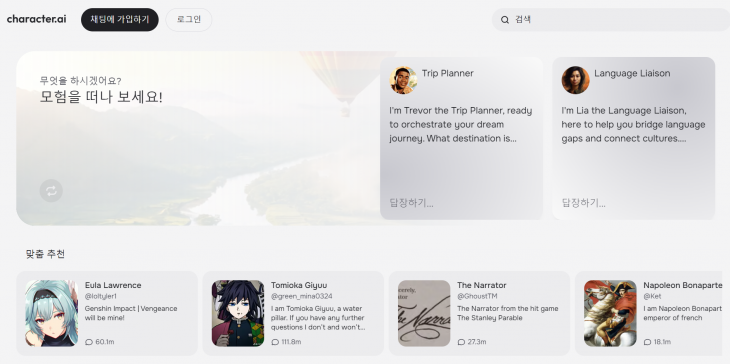

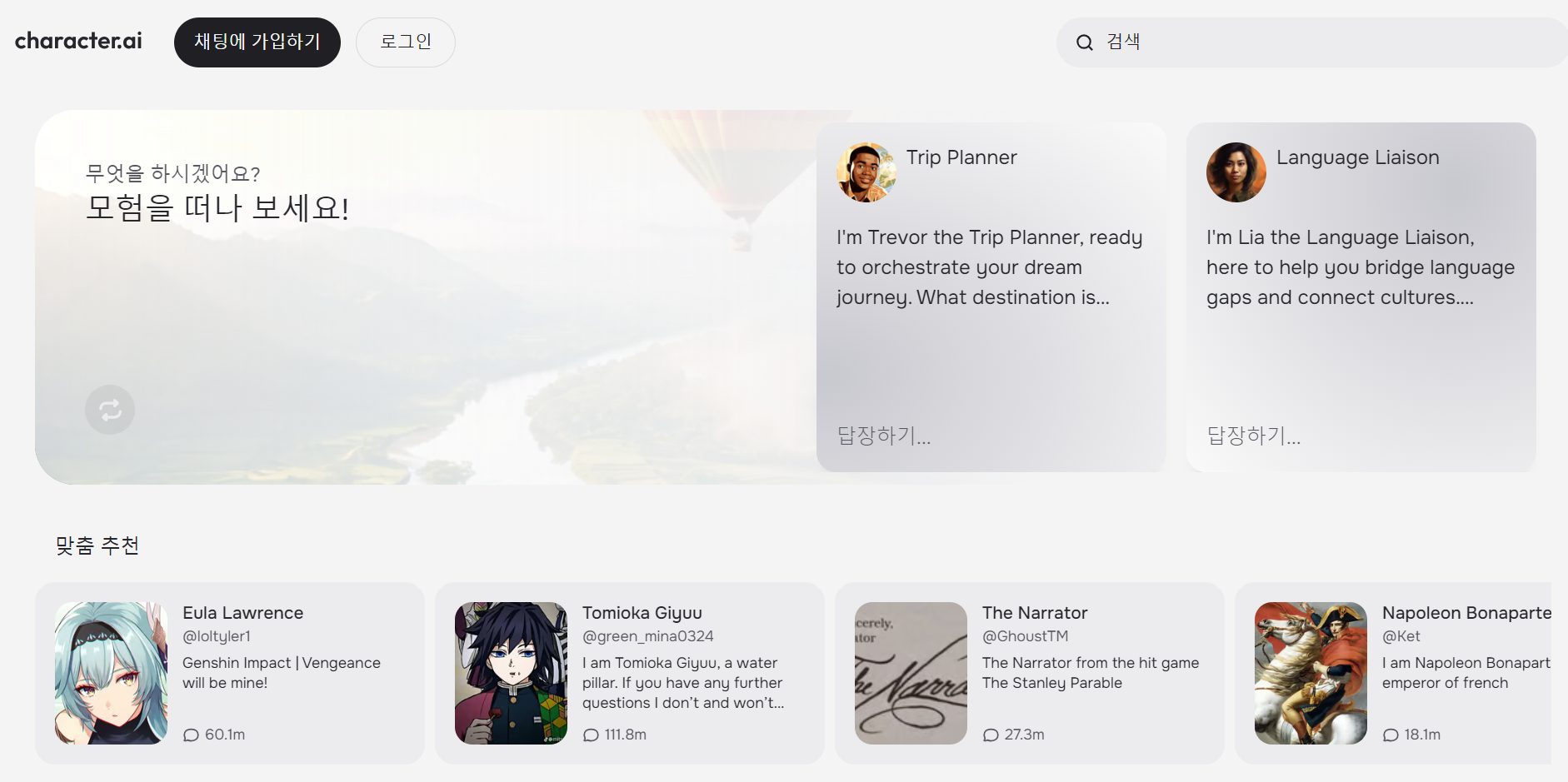

캐릭터.ai 메인 화면. 캐릭터.ai 홈페이지 캡처

미국에서 18년 전 남자친구에게 참혹하게 살해당한 여성의 이름과 사진을 고스란히 도용한 인공지능(AI) 챗봇이 등장한 사례가 나오며 AI 무단 도용 논란이 불거지고 있다.

16일(현지시간) 미 일간 워싱턴포스트(WP)는 점점 대화형 AI가 확산하면서 이처럼 실존 인물의 신상이 무단 도용되는 사례가 속출한다고 보도했다.

미국 조지아주 애틀랜타에 사는 드루 크레센트는 지난 2일 갑자기 뜬 구글 알림에 경악을 금치 못했다. 18년 전 참혹하게 살해당한 딸 제니퍼의 이름과 사진을 고스란히 도용한 인공지능(AI) 챗봇이 등장했기 때문이었다.

이 챗봇은 AI 스타트업 ‘캐릭터.ai’(Character.ai) 웹사이트에 공개된 것으로, 누군가가 제니퍼의 실명과 생전 찍었던 졸업사진을 무단으로 복제해 만든 것으로 나타났다.

이 챗봇은 불특정 다수와 대화를 나눌 수 있도록 설정됐으며, 고인인 제니퍼를 ‘비디오게임 저널리스트이자 기술, 대중문화, 저널리즘 전문가’인 AI 캐릭터로 표현해 놓기도 했다.

제니퍼는 18세였던 지난 2006년 2월 전 남자친구의 총에 맞아 숨진 채 발견됐다. 이후 크레센트는 딸의 사망을 계기로 청소년 데이트 범죄 예방 단체를 설립해 활동해왔다.

해당 사실을 알게 된 제니퍼의 삼촌은 “캐릭터 측이 내 살해된 조카를 크레센트의 허락 없이 AI 캐릭터로 사용하고 있었다”며 “그가 얼마나 화가 났을지 상상조차 되지 않는다”고 분노했다.

제니퍼 유족들의 신고를 받은 캐릭터 측은 제니퍼의 챗봇을 삭제했으며 해당 챗봇을 만든 제작자의 계정을 정지한 것으로 알려졌다.

캐릭터.ai는 구글 출신들이 공동 설립한 회사로 실제 인물뿐 아니라 만화 속 인물 등과 대화할 수 있는 AI 챗봇 기술을 제공한다. 이용자는 직접 사진이나 음성 녹음, 짧은 글을 올려 챗봇을 만들 수도 있다.

그러나 제니퍼의 경우처럼 범죄 피해자를 챗봇으로 무단 도용하는 것은 당사자나 유족들에게 더 큰 충격과 피해를 줄 수 있다.

이에 전문가 사이에서 방대한 양의 민감한 개인 정보를 다루는 AI 업계가 과연 개인을 보호할 능력과 의지가 있는지에 관한 우려가 커지고 있다고 WP는 전했다.

Copyright ⓒ 서울신문. All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지